无服务器冷启动:HF 缓存与预计算哈希

不少团队不仅把 Automatic1111(AUTOMATIC1111 stable-diffusion-webui)当图形界面用,还直接把它当 HTTP API 层。在这种架构上扩缩容时,冷启动少几秒往往就是少付几轮排队与超时——如果你正在压 A1111 的安装与启动时间,下面的两条 Docker...

探索前沿技术,分享实践经验,追踪行业动态

一、服装尺码表 📝 查看完整 Prompt · 服装尺码表 · 卫衣 text Square e-commerce infographic: clothing size chart for a hoodie, clean modern minimal design, white backgrou...

DeepSeek V4 没有像 R1 那样带来那种「全行业抬头看卫星」的传播时刻,但在许多团队眼里,它已经是最便宜、也最「撑得住主业」的一批 Claude Opus / GPT‑5.x 系替代方案 之一。 --- TL;DR(太长不看) - DeepSeek V4 预览于 2026 年 4 月 24...

一、香港 · 三日轻松游 📝 查看完整 Prompt · 三日攻略信息图 · 香港 text Generate a premium three-day Hong Kong travel guide as a vertical infographic poster, 3:4 ratio, styl...

先说明白:为什么要有「第二辑」 第一辑 25 张图,核心是在证明:中文长文本、密级版式、条漫叙事这几件事,GPT-Image-2 能端到端交付。 但这一批我想回答另一个问题:如果题材完全不碰「仿真印刷品」,模型在静物摄影、纯平面、工程示意、编辑拼贴这些「设计系」任务上,会不会同样稳? 我在写 pr...

--- 一、包豪斯几何海报 📝 查看完整 Prompt · 包豪斯几何海报 · 练习稿 text Vertical Bauhaus-style abstract poster exercise, 1920s modernist influence, flat vector only. Compos...

先抛结论 这两天把 Azure OpenAI 的 GPT-Image-2 拉起来跑了 25 张 quality: high 的大图(含一张 8 格品牌叙事条漫),全程无一张人工后期。 结论只有一句:过去三年我用 Midjourney、Stable Diffusion、DALL·E、Flux、Ide...

本文聚焦 Qwen/Qwen3.5-27B 在 vLLM 上的两类常见部署方式: - 4 卡部署:更适合单机 4×4090 这类资源受限环境,优先兼顾可用性与成本。 - 8 卡部署:更接近官方标准示例,适合更长上下文、更高吞吐和更稳定的并发。 同时提供对应的 启动命令、最佳实践、OpenAI 兼容调...

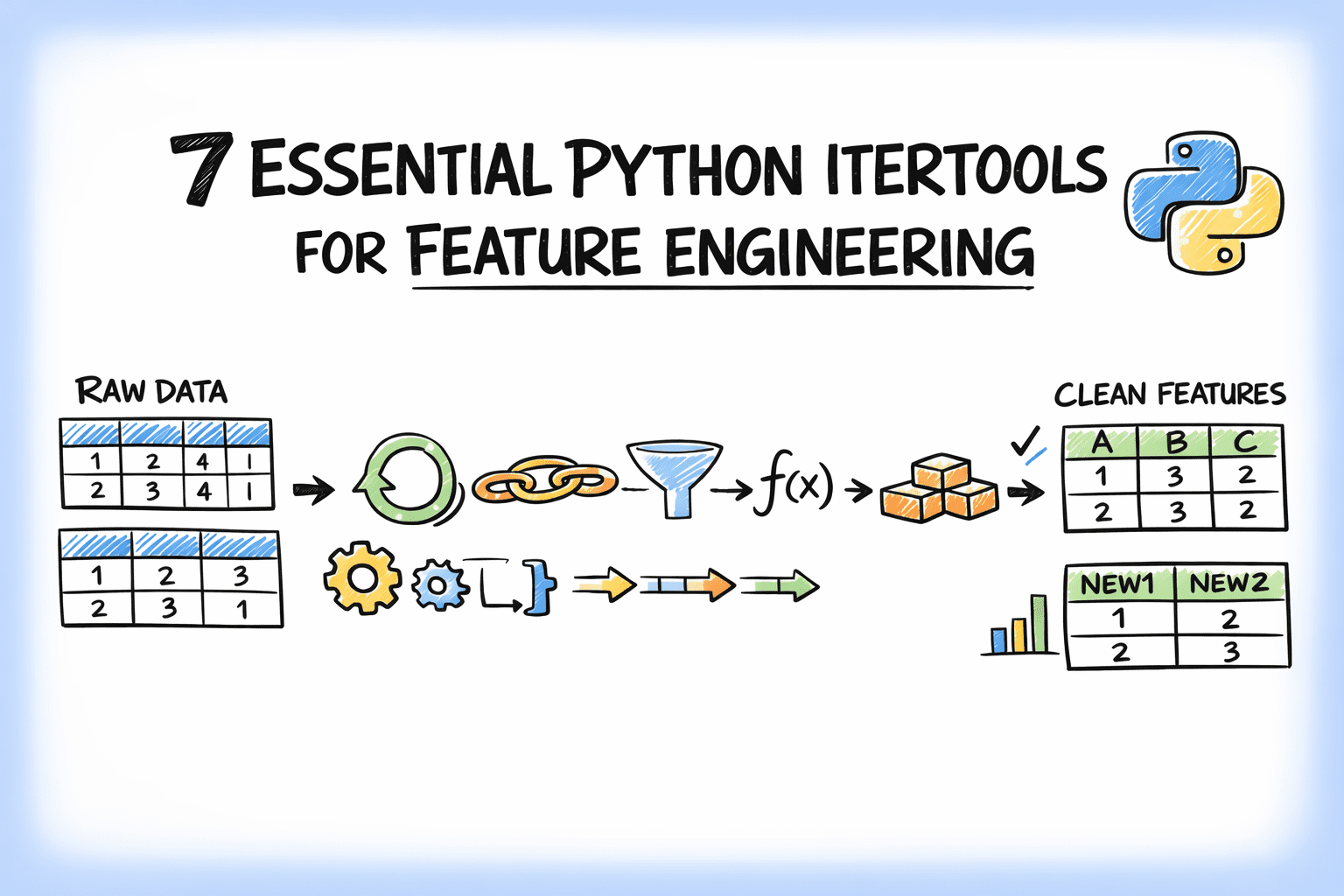

--- 引言 特征工程是机器学习中最重要也最费力的环节。一个好的特征往往比换模型更有效,但这一步通常会产生充满嵌套循环、手工索引和硬编码组合的混乱代码。 Python 的 itertools 模块是标准库中的迭代器工具箱——大多数数据科学家知道它存在,但真正在特征工程中用它的人很少。这是个遗憾,因...

如果说 Qwopus 27B v2 更像一个适合放进 OpenClaw 里做“主脑”的模型,那 Qwopus 9B 给我的感觉更像是另一种角色: 它不一定最强,但更轻、更稳,也更适合先把链路接起来。 所以这次我也单独对 9B 端点跑了一轮完整测试,不和 27B 混在一起讲,而是单独回答一个问题:...

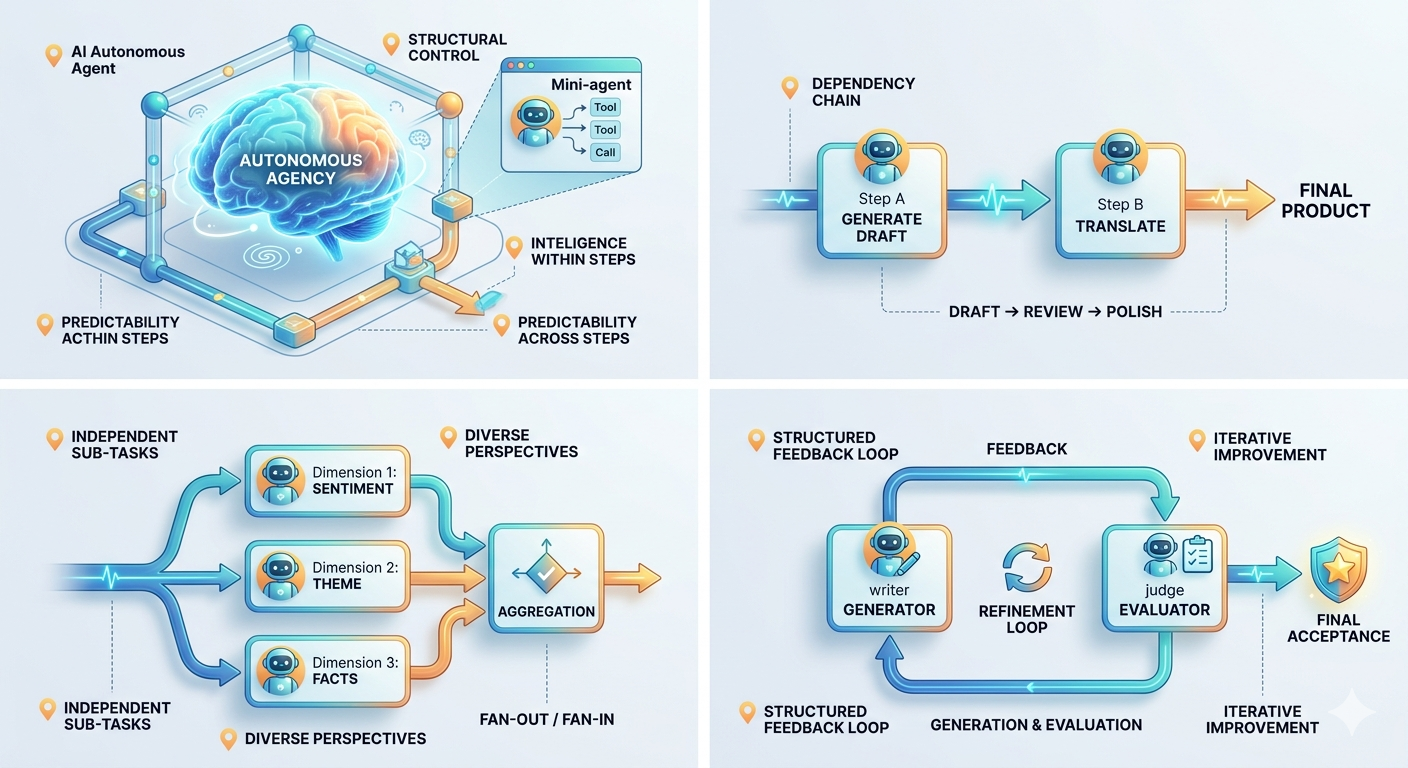

AI 智能体会自主做决策,而工作流的作用,是把这种自主性放进可预期的执行框架里:既保留各步骤内的推理与工具调用,又让整体路径、检查点与节奏可控。 当你需要多个智能体协同完成复杂任务时,真正要拍板的是:哪一种编排模式最贴问题。Anthropic 在与大量团队共建智能体产品的经验里,生产环境绝大多数场...

在 AI 爆发的时代,算力成本成为了悬在每个企业和开发者头顶的达摩克利斯之剑。动辄数万的 4090,价格高昂的 A100/H100,让许多极具潜力的 AI 项目因为“烧不起钱”而被迫搁置。 为了解决这个痛点,共绩算力正式推出了 SPOT 抢占式实例。这不仅仅是一个简单的“降价促销”,而是一套专为解决...

这次我没有只看模型页介绍,也没有只做一轮“你好”测试,而是直接对共绩算力上的 Qwopus 27B v2 端点跑了一套更完整的测试用例,想回答一个更实际的问题: 这个模型,放到真实的 OpenAI 兼容 API 和 OpenClaw 工作流里,到底好不好用? 测试端点: - BASE_URL:ht...

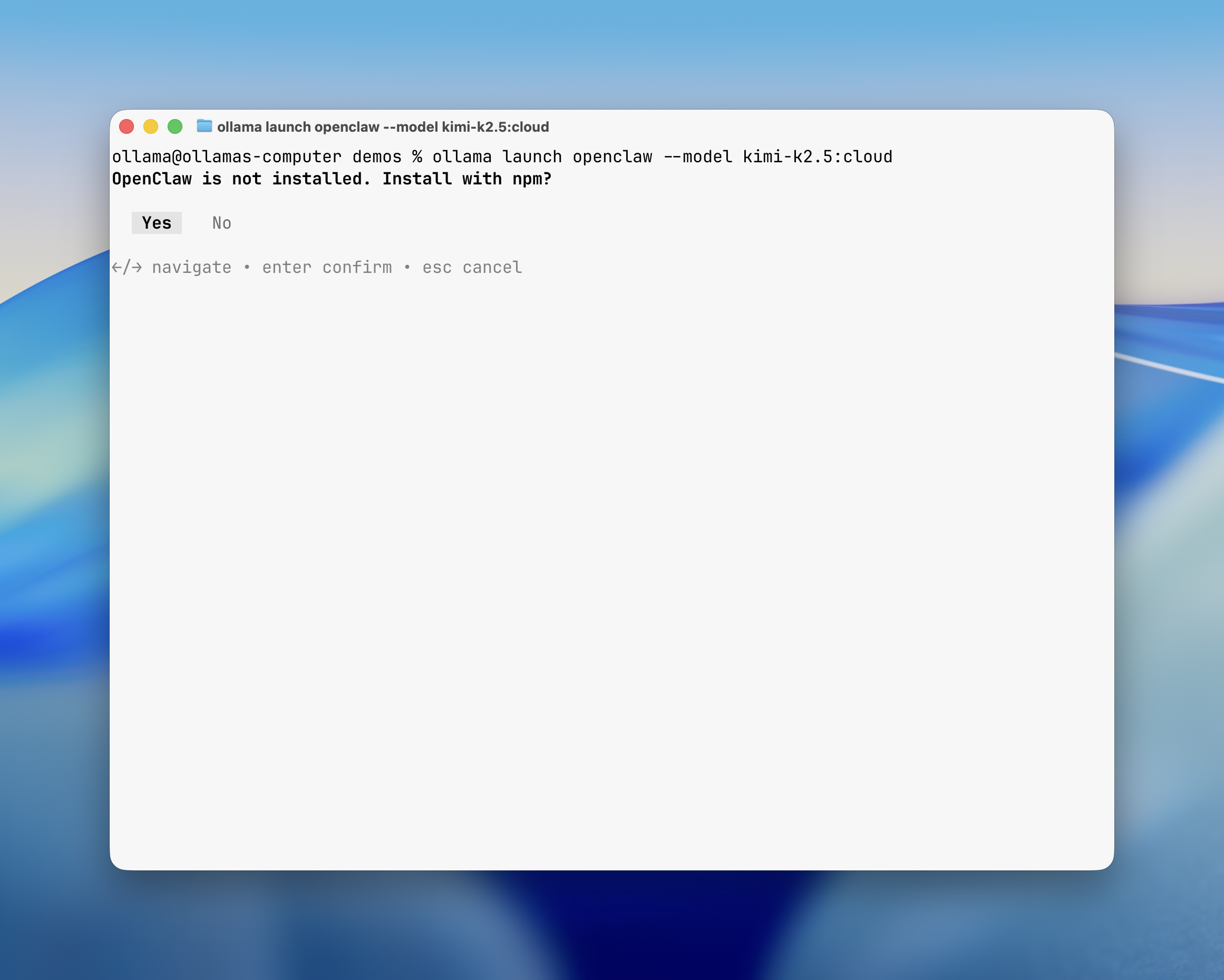

什么是 OpenClaw OpenClaw 是一个运行在本地硬件上的个人 AI 助手,能够帮你: - 清理收件箱、收发邮件 - 管理日历 - 通过 WhatsApp、Telegram、iMessage、Slack、Discord 等你已经在用的聊天 App 完成各类任务 它与 Ollama 0.1...

--- 为什么要理解 Prefill 和 Decode 当你向 ChatGPT 发送一条消息,背后的推理过程并不是一个单一的"计算"——它分成两个截然不同的阶段,具有完全不同的计算特性和性能瓶颈。 理解这两个阶段,以及连接它们的 KV Cache 机制,是优化 LLM 部署、降低延迟、提升吞吐量的...

什么是 Model Spec Model Spec 是 OpenAI 公开发布的模型行为规范文档,定义了旗下模型在各类产品和场景中"应该如何行动"。 它不是一份内部手册,而是一份任何人都可以阅读、审查和讨论的公开文件——目标是让用户、开发者、研究者、政策制定者和公众都能理解 OpenAI 的模型为...

在与 LLM 协作时,上下文工程(context engineering)的重要性持续上升,而提示词工程(prompt engineering)正是其中不可或缺的基础模块。 提示词工程指的是:如何把指令组织好,让模型产出更贴近目标。它涵盖你如何提问、如何规定风格、如何提供背景,以及如何约束模型行为。...

最近我们在共绩算力上反复测试一件事: 把 Claude 风格的推理蒸馏模型,真正接进龙虾(OpenClaw)这种带思考链、工具调用、工作流执行的 Agent 场景里,看它到底能不能干活。 这次主要看两条线: - 9B 版本:便宜、快,适不适合先接起来 - 27B 版本:更强,能不能更像 Claud...